Computador - [Do Latim computatore] Aquele que faz cômputos, que calcula.

Computador Eletrônico - Processador de dados com capacidade de aceitar informações , efetuar com elas operações programadas, fornecer resultados para resolução de problemas. Dividem-se em dois grandes grupos: computadores analógicos e digitais.

Computador Analógico: Aquele que opera com dados representados por quantidades físicas que variam continuamente, realizando processamentos físicos com esses dados.

Computador Digital: Computador que opera com dados discretos ou descontínuos, efetuando uma sequência de processos lógicos e aritméticos com estes dados, num programa previamente preparado.

Um computador eletrônico digital é basicamente integrado por: Unidade Central de Processamento - UCP (em inglês, Central Processor Unit - CPU), unidades de memória, canais de comunicação e dispositivos de entrada e de saída de dados.Dicionário Aurélio da Lingua Portuguesa

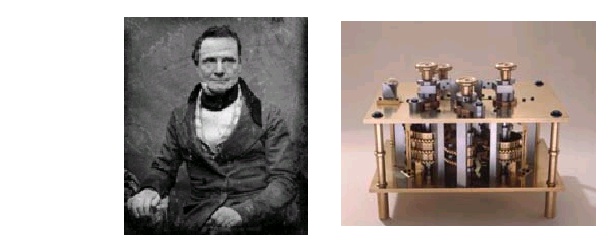

Babbage(1792-1871) é considerado o "Pai do Computador" com o seu projeto de um "Calculador Analítico", muito próximo da concepção do computador atual.

O projeto continha vários elementos que se tornariam mais tarde componentes do computador moderno, tais como: um engenho central, engrenagens e alavancas usadas para a transferência de dados da memória para o engenho central e dispositivos para entrada e saída de dados.(IME-USP)

Babbage não chegou a finalizar o seu projeto pela falta de recursos financeiros e pelas limitações das tecnologias disponíveis na época. Mas em 1985 o Museu de Ciência de Londres iniciou o projeto de construção de uma das máquinas de Babbage que funcionou com sucesso em novembro de 1991.(Museu de Ciência de Londres)

Se Babbage é o "Pai do Computador" então Ada Augusta pode ser considerada "Mãe da Programação" descrevendo como a máquina analítica de Babbage poderia ser programada.

Lady Lovelace (1815-1852), filha do poeta Lord Byron, era entusiasmada pela matemática e tornou-se a primeira programadora, escrevendo séries de instruções para o engenho analítico. Ada inventou o conceito de subrotina: uma sequência de instruções que pode ser usada várias vezes em diferentes contextos. Ela descobriu o valor das repetições - os laços (loops).

No entanto Babbage não foi o primeiro a descobrir uma maneira automática de realizar cálculos. Wilhelm Schickard , (1592--1635) construiu uma máquina que fazia multiplicação e divisão, mas foi perdida durante a Guerra dos Trinta Anos, sem que seu inventor pudesse defender sua primazia. Em 1642, Blaise Pascal, (1623-1662), filósovo e matemático francês construiu uma calculadora que fazia somas e subtrações e em 1670 o matemático alemão Liebniz(1646-1716) aprimorou o projeto de Pascal desenvolvendo uma máquina que era capaz de multiplicar, dividir e calcular raiz quadrada.(IME-USP)

Outro marco importante na história da computação foi o trabalho do matemático inglês George Boole (1815-1864) com a aplicação de operadores lógicos "E"(AND), "OU"(OR) e "NÃO"(NOT) a números binários e o desenvolvimento da Álgebra Booleana, base teórica sobre a qual operam os circuitos dos modernos computadores digitais.Computers in Chemistry, 1999

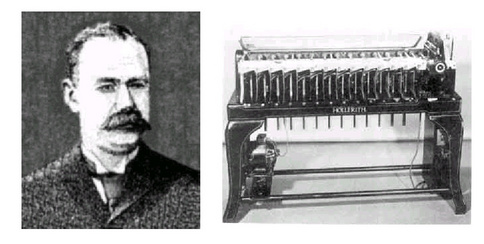

Por volta de 1890, Herman Hollerith (1860-1929), estatístico americano que trabalhava para o Serviço Postal Americano durante o censo de 1880, entrou para a história do computador com o desenvolvimento de uma máquina capaz de organizar e tabular cartões perfurados com dados do censo. Esta inovação permitiu reduzir o tempo de processamento dos dados do censo de 7 para 2 anos e meio!

Mais tarde, Hollerith fundou uma companhia para produzir máquinas de tabulação. Anos depois, em 1924, essa companhia veio a se chamar IBM (International Business Machines Corporation).

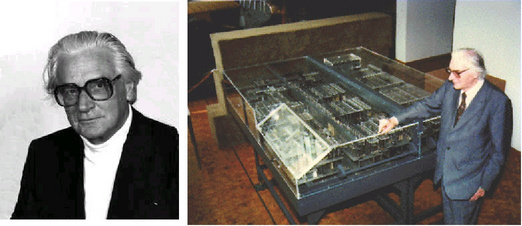

Em 1936, o alemão Konrad Zuse (1910-1995) construiu o primeiro computador eletromecânico com o uso de relês, chamado Z-1.

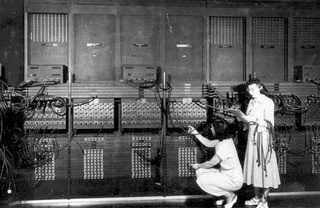

Os engenheiros John Presper Eckert (1919-1995) e John Mauchly (1907-1980) projetaram o ENIAC: Eletronic Numeric Integrator And Calculator, que ficou pronto em 1946. Com 18.000 válvulas, o ENIAC conseguia fazer 500 multiplicações por segundo.

O matemático húngaro John von Neumann (1903-1957) formalizou o projeto lógico de um computador.

Em sua proposta, von Neumann sugeriu que as instruções fossem armazenadas na memória do computador. Até então elas eram lidas de cartões perfurados e executadas, uma a uma. Armazená-las na memória, para então executá-las, tornaria o computador mais rápido, já que, no momento da execução, as instruções seriam obtidas com rapidez eletrônica.

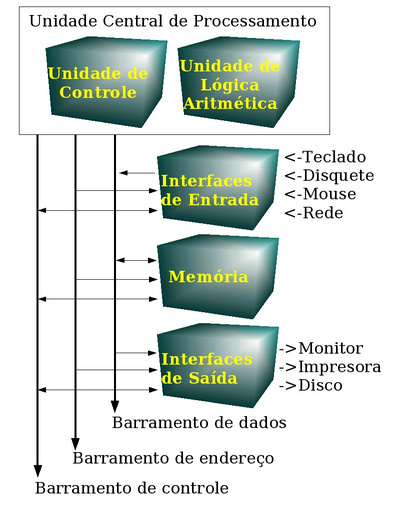

O modelo lógico de computador proposto por von Neumann pode ser descrito resumidamente da seguinte forma.

Unidade Central de Processamento - UCP (em inglês, Central Processor Unit - CPU) constituída por uma Unidade de Controle e uma Unidade de Lógica Aritmética.

Unidade de controle - A unidade de controle controla o funcionamento da unidade lógica e aritmética e da memória. Além disso, ela distribui e organiza tarefas, transfere informações da entrada para a memória e da memória para a saída.

Unidade de lógica aritmética (em inglês, arithmetic logic unit - ALU) - Realiza todas as operações lógicas e aritméticas do computador.

Memória - A memória é o dispositivo de armazenamento de informação do computador. Nela são armazenados tanto as instruções de um programa quanto os dados necessários para a sua execução. A memória é dividida em espaços com endereços.

Barramentos (em inglês, Buses) - O barramento é um conjunto de linhas de comunicação que permitem a interligação entre dispositivos, como o CPU, a memória e outros periféricos.

Unidade de Entrada - Esta unidade traduz informação (por exemplo, letras, números, imagens, marcas magnéticas) de uma variedade de dispositivos de entrada em impulsos elétricos que a CPU entenda.

Unidade de Saída - Esta unidade converte os dados processados, enviados pela CPU em forma de impulsos elétricos, em palavras ou números, que são impressos por impressoras ou mostrados em monitores de vídeo.

A maioria dos computadores de hoje em dia segue ainda o modelo proposto por von Neumann.

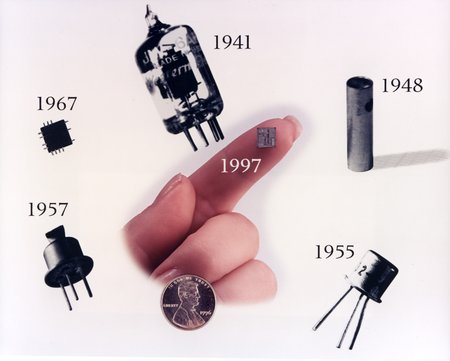

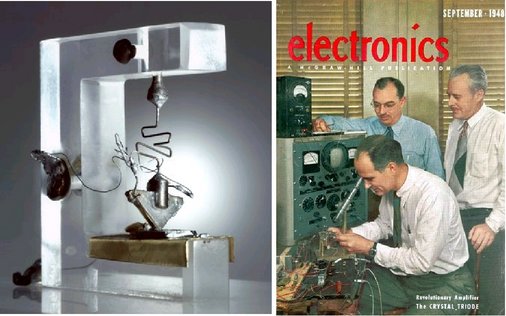

John Bardeen, Walter Brattain e William Shockley descobriram o efeito transistor e montaram o primeiro dispositivo em dezembro de 1947. Usando semicondutores, os transistores poderiam substituir as válvulas, sendo menores, mais rápidos e mais duradouros, além de não esquentarem tanto nem consumirem tanta energia. Surgiram assim os primeiros computadores transistorizados.

Figura 27. Primeiro transistor montado em 1947 nos Laboratórios Bell e ao lado a capa da revista "Electronics" comemorando a grande conquista.

Nos anos 60, sob a influência do programa espacial americano, o desenvolvimento da microeletrônica levou a construção de circuitos transistorizados integrados em uma única pastilha de silício (chip) de dimensões reduzidas. Dezenas de milhares de transistores são integrados em um chip de alguns milímetros quadrados, dando origem aos circuitos integrados microminiaturizados. Isso possibilitou o surgimento de minicomputadores e microcomputadores.

Os computadores de primeira geração (1945-1959) usavam válvulas eletrônicas, quilômetros de fios, eram lentos, enormes e esquentavam muito.

A segunda geração (1959-1964) substituiu as válvulas por transistores e os fios de ligação por circuitos impressos. Isso tornou os computadores mais rápidos, menores e de custo mais baixo.

A terceira geração (1964-1970) foi construída com circuitos integrados, proporcionando maior compactação, redução dos custos e velocidade de processamento da ordem de microsegundos. Tem início a utilização de avançados sistemas operacionais.

A quarta geração, de 1970 até hoje, é caracterizada por um aperfeiçoamento da tecnologia já existente, proporcionando uma otimização da máquina para os problemas do usuário, maior grau de miniaturização, confiabilidade e velocidade maior, já da ordem de nanosegundos (bilionésima parte do segundo).

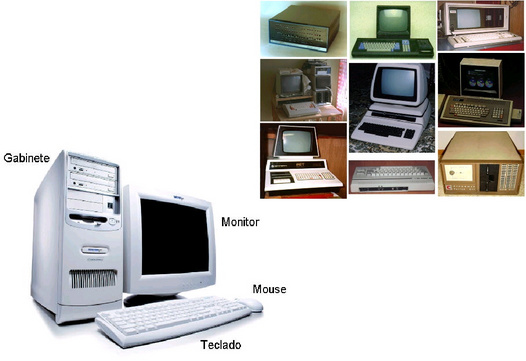

E finalmente chegamos ao PC, o computador da atualidade, mais difundido na sociedade.